开云app登录入口 SwingArena: 从「写对代码Commit」到「通过CI审查」

以前一年,大模子写代码的智力简直以肉眼可见的速率提高。勤俭单剧本到竣工功能模块,GPT、Claude、DeepSeek 等模子如故粗略在几秒钟内生成看起来十分 “专科” 的代码。

这种智力的提高,让好多东说念主驱动崇拜念念考一个问题:AI 能不成确切参与到软件工程的中枢经过中?

但越接近真实设置,这个问题就越显得复杂。因为在工业界,“写出一段能跑的代码” 远远不够。

代码是否能被消失,取决于它能否通过竣工的握续集成(Continuous Integration,简称 CI)活水线——这是一种在代码设置过程中,通过自动化的构建、测试和代码检查,确保每一次蜕变齐能在真实工程环境下褂讪运行的机制。

此外,代码还需妥贴形式程序、经得起代码审查,并在多轮修改中保握褂讪可靠。缺憾的是,现存主流代码评测基准,简直齐停留在“能否通过几个单元测试”的层面。

SwingArena 的起点,恰是填补这块永久缺失的评测空缺。

该论文已被 ICLR 2026 肃穆接收。现在,SwingArena 已达周全栈开源。

论文标题:SwingArena: Competitive Programming Arena for Long-context GitHub Issue Solving

论文不竭:https://arxiv.org/abs/2505.23932

形式不竭:https://swing-bench.github.io/

从 “写对代码” 到 “通过审查”,

评测逻辑需要一次转向

在传统评测中,模子靠近的是一个高度简化的问题:给定函数签名和证明,只好输出能通过测试的达成即可。这种设定关于臆想基础编程智力是灵验的,但它忽略了真实软件设置中最瑕疵的一环 —— 审查与迭代。

在现实中,一段代码频频要阅历多个回合的反应与修改,才能最终被接纳。CI 系统会自动检查编译、测试、代码作风和潜在风险,而审查者则会从逻辑正确性、规模情况和可体恤性等角度抑遏建议质疑。这种过程,本色上是一种握续博弈。

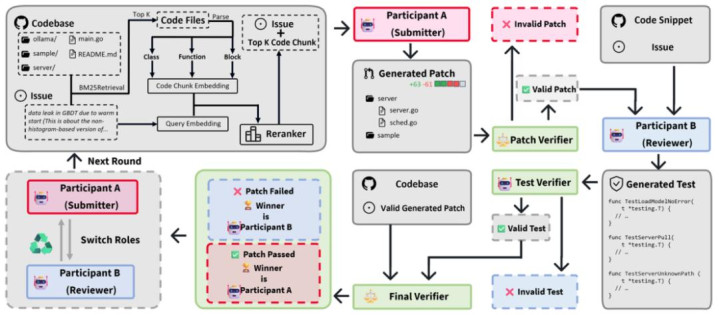

SwingArena 将这种博弈引入评测之中。它不再让模子 “单打独斗”,而是通过抗拒式设定,让两个模子辨别上演 “提交者” 和 “审查者”,在真实 CI 环境中反复交锋。

提交者需要写出饱和适应的补丁才能通过活水线,而审查者则试图通过经心设想的测试线路潜在问题。最终的得分,十足由真实实行成签订定。

真实工程环境,意味着真实复杂度

要让评测确切靠近工业场景,仅有抗拒机制还不够。另一个更现实的挑战在于:真实形式的代码范围,远远超出了大模子的高下文窗口。

一个常见的开源仓库频频包含数万行代码,散播在数百个文献中。模子不可能 “通读全库”,只可在极其有限的高下文中作念判断。SwingArena 因此设想了一套竣工的检索增强活水线 RACG(Retrieval-Augmented Code Generation),试图在 “给模子些许代码” 与 “给对代码” 之间获得均衡。

{jz:field.toptypename/}RACG 的中枢念念路,是先通过经典信息检索顺次快速减轻文献范围,开云中国app登录入口再以语法结构为单元对代码进行切块,并使用语义模子进行精排。在严格的 token 预算下,系统会动态调度高下文粒度,确保模子看到的是最瑕疵、最关系的代码片断,而不是噪声。

消融实验自大,这种分层检索政策,粗略显耀提高补丁定位的准确率,比拟仅使用瑕疵词匹配,Top-10 掷中率提高卓著一倍。这意味着模子不单是 “写代码”,而是在更接近东说念主类工程师的领会范围内使命。

当模子确切抗拒,互异才驱动线路

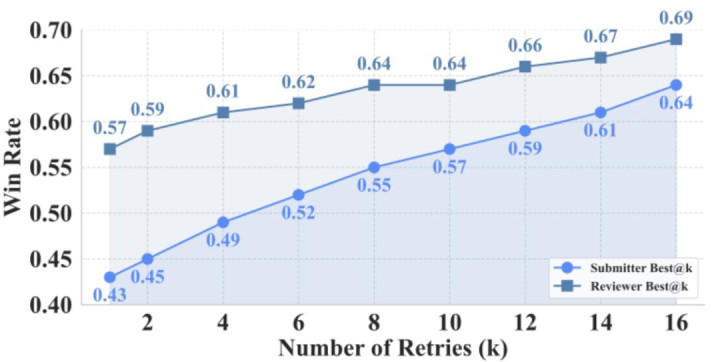

在 SwingArena 的评测中,一个道理的现象逐渐透露:不同模子在工程有蓄意上的 “特性互异”,被前所未有地放大了。

以 GPT-4o 为例,它在提交者变装中推崇得极为激进,频频粗略快速生成足以打败敌手测试的补丁,因此胜率很高。但这种政策的代价是 CI 通过率并不褂讪,代码在表恣意和鲁棒性上更容易出现问题。

比拟之下,DeepSeek 和 Gemini 的推崇则彰着更为保守。它们生成的代码作风愈加程序,通过 CI 的概率也更高,尤其在多言语场景下展现出更强的褂讪性。这类互异,在传统基准中频频被 “平中分” 所诡秘,而在抗拒式评测中却变得相等直不雅。

更进攻的是,这些成果为试验诓骗提供了明晰的参考:当蓄意是快速原型和探索性设置时,激进政策可能更灵验;而在出产环境和永久形式中,褂讪性澄莹更进攻。

从评测到实践:

为什么 SwingArena 值得被嗜好

SwingArena 的兴致兴致,并不单是在于建议了一个新的 benchmark。它更进攻的价值,在于鼓动了一次评测视角的滚动:从 “功能正确性” 走向 “工程可用性”。

通过将 CI 活水线、代码审查和多轮迭代引入评测过程,SwingArena 让咱们第一次粗略系统性地回话这么的问题:哪些模子确实妥贴参加出产环境?在不同工程场景下,应该奈何遴荐和使用它们?又该奈何设想更妥贴现实需求的 AI 编程助手?

在论文匿名期铁心后,SwingArena 将竣工开源,包括数据集、评测框架、检索活水线以及悉数实验复当代码。团队但愿,这套框架不仅能成为商议者比较模子的新器具,也能为工业界评估和落地 AI 编程智力提供参考。

当 AI 生成的代码确切走进 CI 活水线,评测的程序,也必须随之升级。

SwingArena,恰是向这个标的迈出的一步。

备案号:

备案号: